เจาะเบื้องหลัง Google ทำอย่างไรให้ Pixel 4 ถ่ายหน้าชัดหลังเบลอได้คล้ายกล้องโปร?

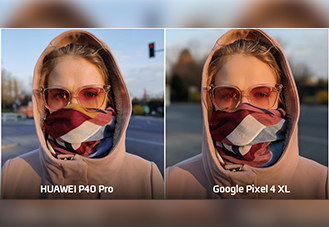

Google เคยสร้างความฮือฮาแห่งกับวงการสมาร์ทโฟนด้วยการเปิดตัว Pixel 2 สมาร์ทโฟนรุ่นแรกของค่ายที่แม้ว่าจะมีกล้องหลังเพียงแค่ตัวเดียว แต่กลับถ่ายภาพหน้าชัดหลังเบลอได้เหมือนกับมือถือกล้องคู่ด้วยพลังแห่ง AI ซึ่งต่อมาใน Pixel 4 และ Pixel 4 XL มือถือตัวท็อปรุ่นล่าสุดก็ได้อัปเกรดไปใช้กล้องหลังคู่เหมือนกับมือถือแบรนด์อื่นๆ แล้ว พร้อมทั้งยังมีการอัปเกรด Portrait Mode ให้ถ่ายภาพหน้าชัดหลังเบลอได้เนียนตากว่าเดิมจนใกล้เทียบชั้นกล้อง SLR เต็มที แต่ Google ทำอย่างไรจึงทำให้ Pixel 4 และ Pixel 4 XL ถ่ายภาพแบบนี้ได้ วันนี้เรามีคำตอบครับ

Recap กันสักหน่อย

มุมมองในแต่ละมุมที่ Dual-Pixel มองเห็น

ก่อนจะเข้าเรื่องว่า Pixel 4 ถ่ายภาพหน้าชัดหลังเบลอด้วยกล้องคู่ได้อย่างไรนั้น เรามาทำความเข้าใจของระบบ Dual-Pixel Auto-Focus System ที่ใช้สำหรับคำนวนระยะชัดตื้น ซึ่งทาง Google นำมาใช้ตั้งแต่รุ่น Pixel 2 และ Pixel 3 กันก่อน โดย Dual-Pixel เป็นการแบ่งพิกเซลแต่ละเม็ดออกเป็นครึ่งนึง พิกเซลที่ถูกแบ่งออกมา มีหน้าที่ในการมองภาพในแต่ละมุมที่ต่างออกไปจากเลนส์กล้องตัวหลัก และด้วยการอ่านค่าของภาพโดยใช้พิกเซลที่ถูกแบ่งครึ่งนี้เอง เราจึงได้มุมมองภาพที่แตกต่างกันออกไปเล็กน้อยแม้จะมีกล้องเพียงแค่ตัวเดียว (ลองนึกภาพเวลาเราปิดตาข้างนึง แล้วสลับมือมาปิดตาอีกหนึ่งข้าง มุมมองของภาพที่ตาเรามองเห็นจะมีความแตกต่างกันเล็กน้อย) โดยวิธีการที่ Google นำมาแยกภาพที่ Dual-Pixel มองเห็นก็คือ Subject จะอยู่ตำแหน่งเดิม ส่วน Background จะขยับขึ้น-ลง

เทคนิคด้านต้นที่ Google นำมาใช้ก็คือ Parallax และการคำนวนขนาดของ Object ต่างๆ ด้วยระยะชัดลึก วิธีการคำนวน Parallax ก็ไม่มีอะไรซับซ้อนเพียงแค่หาสิ่งที่แต่ละครึ่งพิกเซลมองเห็นเหมือนกันหรือต่างกัน และนำไปประมวลผลแยกฉากหน้า-หลัง แต่อย่างไรก็ดี เทคนิค Parallax จะเริ่มด้อยประสิทธิภาพลงเมื่อวัตถุเริ่มมีระยะห่างจากตัวผู้ถ่าย รวมทั้ง Dual-Pixel ยังมีระยะมองเห็น หรือระยะทำการที่หวังผลที่ค่อนข้างต่ำ (Google บอกว่า Baseline น้อยกว่า 1mm.) ส่งผลให้เมื่อถ่ายภาพอะไรที่อยู่ไกลๆ ด้วยโหมด Portrait ระบบจะทำการเบลอได้เนียนตาน้อยกว่าการถ่ายภาพที่อยู่ใกล้ๆ เพราะแต่ละครึ่งพิกเซลมองว่า Subject และ Background ดูจะอยู่บนระนาบเดียวกัน ไม่มีความแตกต่างกันมากนัก

กล้องคู่….สิ่งที่เข้ามาเติมเต็ม Dual-Pixel

มุมมองที่ Dual-Pixel มองเห็น vs มุมมองที่กล้องคู่มองเห็น

แม้ Dual-Pixels จะทำงานได้เยี่ยมแค่ไหน แต่ก็ยังมีข้อจำกัดเรื่องระยะทำการ Google จึงกลับไปทำการบ้านใหม่ พร้อมกับปรับปรุงเซ็ตอัพกล้องยกชุดในรุ่น Pixel 4 ด้วยการติดตั้งกล้องเลนส์มุมกว้าง และเลนส์ซูมมาให้ในเครื่องเดียว กล้องแต่ละตัวมีระยะการมองเห็นภาพที่ต่างกันถึง 13 มม. มากกว่า Baseline ของ Dual-Pixel หลายเท่า ทำให้การทำ Parallax เพื่อคำนวนหาความชัดตื้นของ Object ดีขึ้นตามไปด้วย ลองมองดูภาพด้านซ้ายบนที่กล้อง Dual-Pixel มองเห็น และภาพด้านขวาที่กล้องคู่บนมองเห็น จะเห็นได้ว่า การแยกแยะ Subject และ Object ด้วยกล้องคู่ ทำได้ดีกว่ามาก

แม้ว่าจะมีกล้องคู่แล้ว Google ก็ยังไม่ลืม Dual-Pixel เพราะข้อมูลที่เจ้าเทคโนโลยีนี้เก็บมาได้นั้น ยังคงมีความสำคัญอยู่ โดย Google ใช้ประโยชน์ของกล้องคู่ที่มีมุมมองในการถ่ายภาพที่มองเห็นความแตกต่างกันมากขึ้น ทำให้ Dual-Pixel สามารถโฟกัสเข้าเป้าไปที่ Subject ได้ทันทีโดยที่ไม่ต้องนำข้อมูลที่แต่ละพิกเซลมองเห็นไปทำการวิเคราะห์เพื่อแยกฉากหน้า-หลังอีกรอบ หรือต้องรอข้อมูลจากกล้องตัวที่สองเพื่อประมวลผลต่อ

กล้องคู่ และ Dual-Pixel ยังไม่พอ เพราะซอฟท์แวร์ต้องฉลาดด้วย!

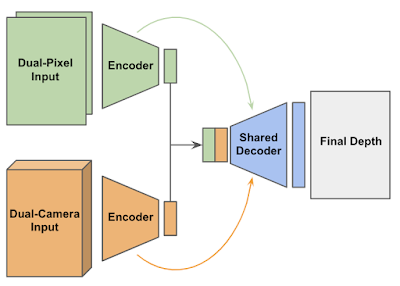

แม้ Dual-Pixel และ กล้องคู่ จะแยกแยะ Subject ได้ดีเพียงใด แต่ Google ก็ไม่มองข้ามในเรื่องของซอฟท์แวร์ประมวลผลข้อมูลที่ทั้งสองสิ่งนี้ได้รับมา โดยใน Pixel 4 นั้น Google ใช้ Tensorflow (ไลบราลีสำหรับพัฒนา Machine Learning) เพื่อทำการประมวลผลในรูปแบบ Convolutional Neural Network หรือการวิเคราะห์รูปภาพตามรูปแบบที่มนุษยษ์มองเห็น โดยเทคนิคการทำงานก็คือ ระบบจะทำการประมวลผลจากข้อมูลภาพที่ Dual-Pixel และกล้องคู่ ได้รับมาแบบแยกออกจากกันโดยใช้ Encoder คนละแบบ จากนั้นก็จะนำผลลัพธ์ที่ได้ไปเข้า Encoder อีกตัวที่ใช้สำหรับถอดข้อมูลจาก Dual-Pixel และกล้องคู่ ทำให้ได้ค่าความชัดตื้นที่แท้จริงในขั้นตอนสุดท้าย

ส่วนวิธีการเทรนโมเดลสำหรับใช้ถอดข้อมูล Input ที่ได้รับมาจาก Dual-Pixel และกล้องคู่ Google ใช้เทคนิคที่เรียกว่า Drop-out โดยตั้งข้อกำหนดไว้ว่า จะมี Input หนึ่งที่รีเซ็ตค่าที่ได้มากลับไปเป็นศูนย์แบบแรนดอมขณะถูกเทรน เพื่อสอนให้โมเดลยังคงสามารถทำงานได้แม้ว่าไม่ได้รับข้อมูลจาก Input นั้นๆ ยกตัวอย่างเช่น การถ่ายภาพในบางสถานการณ์ที่ใกล้จนเกินไปจนทำให้กล้องตัวที่สองไม่สามารถโฟกัสเข้าวัตถุได้

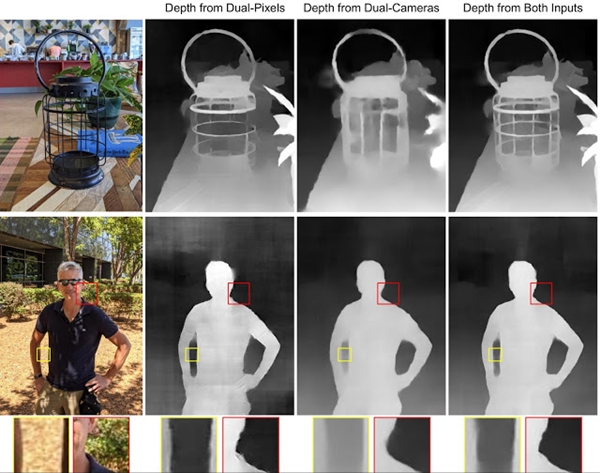

พูดแล้วอาจจะยังมองไม่เห็นภาพ ลองสังเกตภาพตะเกียงด้านบน ที่ข้อมูลระยะชัดตื้นจากทั้ง Dual-Pixel และกล้องคู่เก็บเส้นสายของตะเกียงมาได้ไม่ครบ แต่ก็ยังสามารถแยกแยะวัตุ และฉากหลังได้อย่างเนียนตาด้วยการนำข้อมูลระยะชัดตื้นที่ได้รับมาจาก Dual-Pixel มาวิเคราะห์รวมกับกล้องคู่ ส่วนการถ่ายภาพคน Dual-Pixel จะเก็บข้อมูลระยะชัดตื้นในส่วนของช่องว่างระหว่างแขน และเสื้อได้ดีกว่า ส่วนกล้องคู่จะะเก็บข้อมูลระยะชัดตื้นระหว่างฉากหลัง และดีเทลต่างๆ ที่อยู่บนพื้นได้ดีกว่า ทำให้การเบลอดูมีความเป็นธรรมชาติ ไม่ใช่การเบลอฉากหลังทั้งหมดเป็นระนาบเดียวกัน

แล้วทำโบเก้ยังไงให้เหมือนกล้องโปร?

โบโก้ หรือดวงไฟก้อนกลมที่เกิดมาจากวัตถุที่อยู่นอกระยะโฟกัส เป็นอีกหนึ่งสิ่งที่หลายคนต้องการเมื่อถ่ายภาพแบบหน้าชัดหลังเบลอ ซึ่งในกล้อง SLR ระดับสูงนั้น การทำโกเก้จะค่อนข้างดูเนียนตา เพราะไฮไลท์ต่างๆ อย่างเช่น ดวงไฟ, ผิวน้ำ หรือแสงว่างที่สอดลอดผ่านต้นไม้ ที่อยู่นอกระยะโฟกัสจะสว่างเป็นดวงกลม แม้ว่าไฮไลท์เหล่านั้นจะอยู่ไกล แต่เราก็ยังมองเห็นโบเก้ได้อย่างสว่างคมชัดเช่นเดิม

วิธีที่ Google นำมาใช้ในการสร้างโบเก้ก็คือการแทนภาพโบเก้เข้าไปในแต่ละพิกเซล ขนาดของโบเก้จะขึ้นอยู่กับข้อมูลระยะชัดตื้นที่ได้รับมา แต่อย่างไรก็ดี กล้องมือถือมีข้อจำกัดด้านฮาร์ดแวร์ และเลนส์ที่ไม่สามารถทำเอฟเฟ็กต์โบเก้เหมือนกับกล้องใหญ่ได้ โดยในแต่ก่อน เอฟเฟ็กต์ฉากหลังเบลอจะถูกทำหลังจากผ่านกระบวนการ Tone Mapping (กระบวนการประมวลผลข้อมูลดิบเป็นภาพถ่ายที่สามารถดูได้บนมือถือ) โดย Tone Mapping จะทำการบีบอัดข้อมูลสำคัญเกี่ยวกับภาพถ่ายอย่างเช่น Dynamic Range ที่จะทำให้เงามีความสว่างสอดคล้องกับ Hightlight แต่ข้อเสียก็คือ ภาพที่ออกมาในผลลัพธ์สุดท้ายจะสูญเสียข้อมูลด้านความสว่างของ Object ที่อยู่ในซีน ทำให้เป็นการยากที่ซอฟท์แวร์จะทำโบเก้ดวงกลมสวยๆ ส่งผลให้โบเก้ถูกเบลอรวมไปกับ Background ไม่ใช่โบเก้ดวงกลมเด่นๆ เหมือนกับกล้อง SLR

ดังนั้น Google จึงต้องคิดค้นหาวิธีแก้ใหม่ด้วยการทำเอฟเฟ็กต์เบลอบนภาพดิบที่ถูกถ่ายด้วยเทคโนโลยี HDR+ จากนั้นค่อยมาทำ Tone Mapping ทับอีกรอบ ซึ่งนอกเหนือจากจะทำให้โบเก้ที่ออกมามองเห็นเป็นดวงกลมชัดแล้ว Background ก็มีความอิ่มตัวของสีไปในทิศทางเดียวกันกับ Foreground ด้วย

จะเห็นว่าการถ่ายภาพหน้าชัดหลังเบลอที่ใช้เวลาไม่กี่วินาที แต่หลังบ้านของ Pixel 4 มีการทำงานร่วมกับอย่างไร้รอยต่อระหว่างฮาร์ดแวร์ และซอฟท์แวร์ เพื่อให้ผู้ใช้ได้ภาพสวยๆ สักหนึ่งใบ โดย Google ก็ได้แนะนำว่า หากผู้ใช้รายใดที่ใช้ Pixel 4 อยู่ และต้องการให้โหมดหน้าชัดหลังเบลอมีประสิทธิภาพอยู่ในระดบัสูงสุด ให้ลองถือกล้องหากจากวัตถุเป็นระยะอย่างน้อย 20 เซนติเมตร (เนื่องจากเป็นระยะโฟกัสที่กล้อง Telephoto ทำงานได้) ก็จะได้ภาพ Portrait ที่สวยงามขึ้น ซึ่งก็น่าสนใจว่าใน Pixel รุ่นหน้า ทาง Google จะพัฒนากล้องไปในทิศทางใดอีกบ้างครับ

ที่มา : Google blog

วันที่ : 18/12/2562